- Das Training großer KI-Modelle verursacht erhebliche CO2-Emissionen, was neuromorphes Computing durch effizientere Hardware adressiert.

- Die Von-Neumann-Architektur von Computern führt zu hohen Latenzzeiten und erheblichem Energieverbrauch bei Datenverarbeitung.

- In-Memory-Computing reduziert Energiebedarf, indem Speicherung und Verarbeitung an einem Ort vereint werden.

- Neuromorphe Chips arbeiten adaptiv und benötigen nach der Aufgabe keinen Strom mehr, was die Energieeffizienz stark erhöht.

Das menschliche Gehirn ist um fünf Größenordnungen leistungsfähiger als jede künstliche Intelligenz. Sprachverständnis und Bilderkennung sind zwei Bereiche, in denen der Unterschied zwischen dem Gehirn und herkömmlichen Computern bereits besonders intensiv erforscht wurde. So liegt beispielsweise die Rate der korrekten Bilderkennung einer trainierten KI je nach Ausstattung selten über 90 %.

Dies ist eine Herausforderung für KI-Entwickler und wird durch ein ernstes Energieproblem noch verschärft. Das Training einer groß angelegten Spracherkennungs-KI erzeugt über 300 kg CO2, was in etwa dem CO2-Fußabdruck eines durchschnittlichen 17-jährigen Amerikaners entspricht.

Neuromorphes Computing bezeichnet die Verarbeitung von Daten in einer Weise, die der des menschlichen Gehirns ähnelt. Die Leistung von Neuronen wird durch mikroelektronische Komponenten nachgeahmt. Dadurch werden unermessliche Rechenleistung und Geschwindigkeit möglich.

In einem Interview mit RFID & Wireless IoT Global erklärt Dr. Thomas Kampfe, Gruppenleiter Integrierte RF & KI am Fraunhofer-Institut für Photonische Mikrosysteme IPMS, warum die Zukunft des Computing nicht mehr in Zentralprozessoren (CPUs), sondern in neuronalen Prozessoren (NPUs) liegt.

Edge Computing

Datenverarbeitung mit hohem Energieverbrauch und geringer Rechenleistung

Das Internet der Dinge (IoT) wird bis 2028 weltweit voraussichtlich um mehr als 25 Prozent pro Jahr wachsen. Homeoffice, Smart Home, Smart Health, Cloud Computing, E-Commerce – die Zahl der datengenerierenden Anwendungen, die in den Alltag immer größerer Bevölkerungsgruppen integriert werden, nimmt deutlich zu. In der Industrie und der industriebezogenen Forschung werden auch Supercomputer, autonomes Fahren und neuartige KI-Algorithmen erforscht. Weltweit gibt es ein Datenwachstum von 40 Prozent pro Jahr. Bis 2020 werden 97 Prozent des gesamten netzwerkbasierten globalen Datenverkehrs über Rechenzentren verarbeitet worden sein.

Rechenzentren sind besonders wichtig im Bereich des maschinellen Lernens. Das Training eines Algorithmus für die Sprach- oder Bilderkennung ist sehr komplex und kann monatelange ununterbrochene Rechenzeit erfordern. Ohne diese Algorithmen sind Datensätze noch schwieriger zu analysieren. Daher sind Rechenzentren unglaublich wichtig. Angesichts wachsender Datenströme sind sie jedoch nicht so leistungsfähig wie gewünscht. Meist werden nur 45 % ihrer Rechenkapazität genutzt; eine 100-prozentige Auslastung kommt selten oder gar nicht vor. Für Echtzeitanwendungen hingegen sind herkömmliche Computerstrukturen einfach nicht leistungsfähig genug.

Dr. Thomas Kämpfes Arbeit findet an dieser Schnittstelle zwischen dem Streben nach energieeffizientem Rechnen und leistungsstarken Komponenten statt. „Die Lösung des Energieproblems beim Rechnen durch Effizienzsteigerung – das ist ein Schwerpunkt der aktuellen Forschung in der Halbleiterindustrie, und hier liegt auch der Beitrag des Fraunhofer-Leitprojekts NeurOSmart, zu dem meine Forschung gehört“, erklärt Thomas Kämpfe. Zusammen mit seinem Team entwickelt er mikroelektronische Chips, die in Bezug auf Leistung und Effizienz den neuronalen Netzwerken des Menschen nachempfunden sind. Ihr Energieverbrauch ist extrem gering.

Das Energieproblem der Datenverarbeitung

Der CO2-Fußabdruck aller Rechenzentren weltweit beträgt etwa 100 Megatonnen CO2, was mit dem jährlichen Fußabdruck der amerikanischen Verkehrsluftfahrt vor der Corona-Pandemie vergleichbar ist. Prognosen zufolge wird dieser Fußabdruck in den nächsten zehn Jahren um das 2- bis 9-fache steigen. Im Jahr 2030 könnte der Stromverbrauch allein durch Rechenzentren 974 TWh erreichen. Zum Vergleich: In Deutschland wurden 2021 565 TWh Strom verbraucht. Der hohe Stromverbrauch ist auf die Von-Neumann-Architektur zurückzuführen, das zugrunde liegende Konstruktionsprinzip herkömmlicher Computer.

Im Wesentlichen laufen alle Kommunikationsprozesse in einem solchen Computer über den Bus: Die Eingabe wird an den Bus weitergeleitet, der sie dann an die Recheneinheit und den Speicher und schließlich an Ausgabegeräte oder andere angeschlossene Peripheriegeräte weiterleitet. In dieser geteilten Computerarchitektur gibt es vier Stellen – weil alles über den Bus läuft –, an denen eine Datenübertragung stattfinden muss. Für jede Übertragung wird Strom benötigt.

Die Effizienz von Computer- und Serverarchitekturen

Dies erklärt auch die geringe Effizienz herkömmlicher Computer. In der Von-Neumann-Architektur kann jeweils nur eine der Komponenten auf den Bus schreiben. Gleichzeitige Schreibvorgänge sind nicht möglich, was die Rechengeschwindigkeit eines solchen Systems begrenzt. Latenzzeiten sind nicht auszuschließen. Ähnlich verhält es sich bei Rechenzentren: Daten werden dorthin übertragen, verarbeitet und wieder zurückübertragen, Latenzzeiten inklusive. Um die Rechengeschwindigkeit zu erhöhen, können Rechendienste jedoch näher am Ort ihres Entstehens bereitgestellt werden, ohne dass ein Server erforderlich ist.

Das ist das Prinzip des Edge Computing: Anstatt alle Daten energie- und zeitaufwändig zum zentralen Server und von dort wieder zurück zu übertragen, wird die Datenverarbeitung am Rand des Netzwerks durchgeführt. Auf diese Weise können Latenzzeiten bereits minimiert und Echtzeitdienste ermöglicht werden. Edge Computing wird auch als „Near Memory Computing” bezeichnet, also im Grunde genommen als Datenverarbeitung in der Nähe des Speichers.

In-Memory-Computing

Unser erklärtes Ziel ist es, den Stromverbrauch in Rechenzentren zu senken

Thomas Kämpfe, Gruppenleiter Integrated RF & AI am Fraunhofer IPMS, erforscht mikroelektronische Komponenten mit besonders geringem Energieverbrauch. Der Forschungsschwerpunkt liegt auf In-Memory-Computing. „Beim In-Memory-Computing erfolgt die Speicherung in der Recheneinheit. Alles wird an einem Ort verarbeitet. Zwischenspeicherungen werden nach Möglichkeit vermieden, weshalb weniger Energie benötigt wird“, erklärt Thomas Kämpfe.

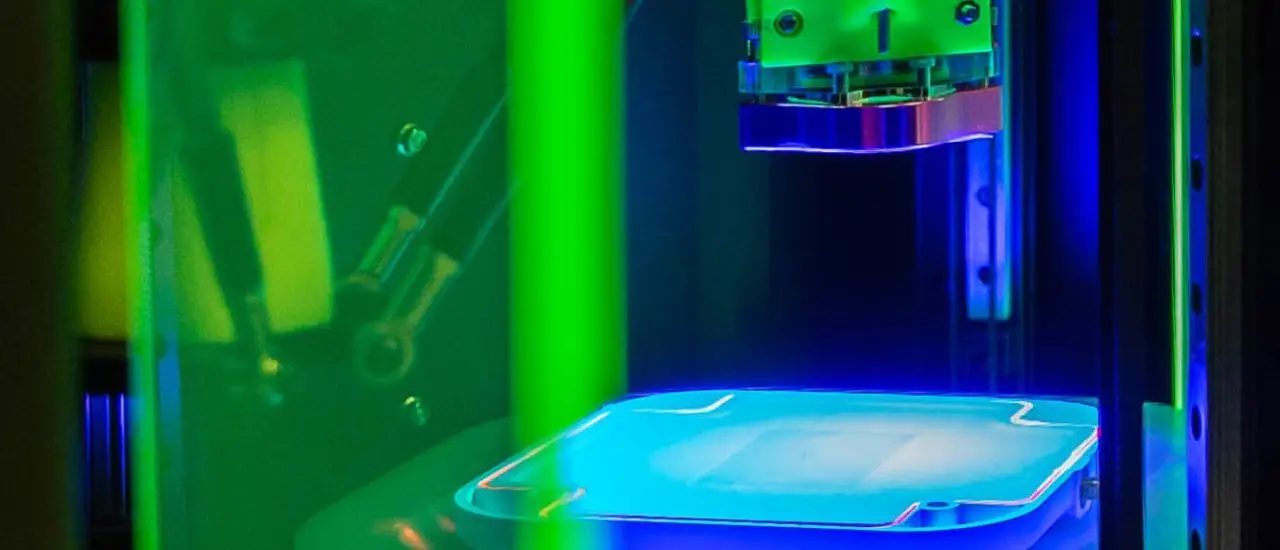

Die Miniaturisierung von Komponenten ist ein Schwerpunkt der industriebezogenen Forschung am Fraunhofer IPMS. Dort wird seit langem daran gearbeitet, diese Prozesse auf die Größenordnung eines Chips zu übertragen. In Zusammenarbeit mit verschiedenen Transistoren werden verschiedene Arten von Speichern getestet. Das Ziel ist die Entwicklung eines Speichers, der klein und dennoch leistungsfähig ist.

„Unser erklärtes Ziel ist es, den Stromverbrauch in Rechenzentren zu senken. Beim In-Memory-Computing werden die Daten in der Recheneinheit gespeichert. Alles wird an einem Ort verarbeitet. Zwischenspeicherungen werden so weit wie möglich vermieden, wodurch weniger Energie benötigt wird.“

Dr. Thomas Kämpfe – Gruppenleiter Integrierte RF & AI, Fraunhofer IPMS

Pilotprojekt mit Industrierobotern

In einem laufenden Pilotprojekt wird die Zusammenarbeit zwischen Mensch und Roboter mittels LiDAR aufgezeichnet. Der Schwerpunkt liegt dabei vor allem auf der Erkennung von Menschen in unmittelbarer Nähe eines Roboters mit KI. Der Roboter erfasst seine Umgebung mithilfe von LiDAR-Sensoren präzise und dreidimensional.

Ziel dieses Projekts ist es, die Bewegung des Roboters in Abhängigkeit von der Bewegung des Menschen zu verändern. Die Bewegungsanpassung des Roboters muss sehr schnell erfolgen. Es darf keine sicherheitsrelevante Lücke aufgrund von Latenzzeiten geben. Für Anwendungen dieser Art wird am Fraunhofer IPMS eine neue Beschleunigergeneration für KI-Algorithmen entwickelt, um die Sicherheitslücke zu schließen.

KI und komplexe Algorithmen

Die Verarbeitung großer Datenmengen in (nahezu) Echtzeit allein wird oft als KI-Anwendung bezeichnet.

„Das ist noch weit entfernt von kognitiver künstlicher Intelligenz, die beispielsweise über ein Bewusstsein verfügt“, erklärt Thomas Kämpfe. „KI im heutigen Sprachgebrauch beginnt dort, wo man einen Algorithmus entwickelt, der etwas verarbeiten kann, was man vorher nicht verarbeiten konnte, und der sogar vorausschauend sein kann. Ein Teil davon kann jedoch als maschinelles Lernen klassifiziert werden. Das ist der Entwicklungsschritt vor der KI, bei dem komplexe Regressionsanalysen über große Datenmengen durchgeführt werden, um Ergebnisse zu generieren. Eine KI analysiert jedoch nicht. Letztendlich hat man bei einer KI keine Möglichkeit zu erfahren, wie genau die KI die Daten auswertet und warum der Algorithmus die gewählte Lösungsvariante ausgewählt hat.“

Neuromorpher Halbleiterchip

Neuromorphes Computing

„In-Memory-Computing versucht, Vorgänge zu beschleunigen oder zu vereinfachen, die Sie in KI-Algorithmen ständig benötigen“, erklärt Thomas Kämpfe. Neuromorphes Computing ist der nächste Schritt in diese Richtung. Basierend auf In-Memory-Computing geht es dabei um die Entwicklung von Netzwerken elektromagnetischer Neuronen, die Echtzeit-Rechenleistung ermöglichen. Neuronen werden durch eine elektrische Ladung stimuliert, die über einen Nervenreiz übertragen wird. Sie wiederum übertragen Informationen über Synapsen an andere Neuronen. Bei künstlichen Neuronen in neuromorphen Chips ist das genauso. Die einzelnen Neuronen sind über Synapsen miteinander verbunden.

Nicht alle Neuronen werden für Rechenoperationen benötigt – nur einige sind notwendig. Die Art der Verbindung, die bei einem bestimmten Rechenvorgang auftritt, hat Gewicht. Wie genau einzelne Neuronen angesprochen werden, lässt sich aus den Gewichten aller ihrer Verbindungen als gewichtete Summe berechnen. Ein neuromorpher Chip organisiert und reguliert sich ähnlich wie das menschliche Gehirn. Datenverarbeitung und Datenspeicherung verschmelzen in ihm, und er kann sich je nach Aufgabe plastisch an die erforderliche Leistung anpassen. Mit anderen Worten: Ein neuromorpher Chip kann Aufgaben bewältigen, für die er nicht programmiert wurde.

Nach Abschluss der Aufgaben konfiguriert er sich ohne weiteren Stromverbrauch neu. Allein aus diesem Grund benötigen neuromorphe Chips sehr wenig Strom. Darüber hinaus ist kein ständig angelegter Energieimpuls erforderlich. Ein künstliches Neuron beginnt seine Arbeit in dem Moment, in dem ein Reiz eintrifft, und beendet sie Bruchteile einer Sekunde später.