- Le calcul neuromorphique imite le cerveau humain pour réduire fortement la consommation énergétique des centres de données.

- L’architecture de Von Neumann traditionnelle limite la vitesse et l’efficacité énergétique des ordinateurs classiques.

- Le calcul en mémoire fusionne traitement et stockage, évitant des transferts énergivores de données.

- Le projet NeurOSmart développe des puces à faible consommation pouvant s’adapter aux tâches en temps réel.

Le cerveau humain est cinq fois plus performant que n'importe quelle intelligence artificielle. La compréhension du langage et la reconnaissance d'images sont deux domaines dans lesquels la différence entre le cerveau et les ordinateurs conventionnels a déjà fait l'objet de recherches approfondies. Par exemple, selon l'équipement utilisé, le taux de reconnaissance d'images correctes d'une IA entraînée dépasse rarement 90 %.

Il s'agit là d'un défi pour les développeurs d'IA, qui est aggravé par un grave problème énergétique. L'entraînement d'une IA de reconnaissance vocale à grande échelle génère plus de 300 kg de CO2, ce qui équivaut à peu près à l'empreinte carbone d'un Américain moyen de 17 ans.

Le calcul neuromorphique désigne le traitement des données d'une manière similaire à celle du cerveau humain. Les performances des neurones sont imitées par des composants microélectroniques. Une puissance et une vitesse de calcul incommensurables deviennent ainsi possibles.

Dans une interview accordée à RFID & Wireless IoT Global, le Dr Thomas Kampfe, chef du groupe RF & IA intégrées à l'Institut Fraunhofer pour les microsystèmes photoniques IPMS, explique pourquoi l'avenir de l'informatique ne réside plus dans les unités centrales de traitement (CPU), mais dans les unités de traitement neuronal (NPU).

Edge Computing

Traitement des données avec une consommation d'énergie élevée et une faible puissance de calcul

L'Internet des objets (IoT) devrait connaître une croissance mondiale de plus de 25 % par an jusqu'en 2028. Bureaux à domicile, maisons intelligentes, santé intelligente, cloud computing, commerce électronique : le nombre d'applications génératrices de données qui s'intègrent dans la vie quotidienne de groupes de population toujours plus importants augmente considérablement. Dans l'industrie et la recherche liée à l'industrie, les supercalculateurs, la conduite autonome et les nouveaux algorithmes d'IA font également l'objet de recherches. La croissance mondiale des données est de 40 % par an. D'ici 2020, 97 % de tout le trafic mondial de données en réseau aura été traité par des centres de données.

Les centres de données sont particulièrement importants dans le domaine de l'apprentissage automatique. L'entraînement d'un algorithme pour la reconnaissance vocale ou visuelle est très complexe et peut nécessiter des mois de calcul ininterrompu. Sans ces algorithmes, les ensembles de données sont encore plus difficiles à analyser. Les centres de données sont donc extrêmement importants. Cependant, ils ne sont pas aussi puissants que souhaité face à l'augmentation des flux de données. La plupart du temps, seuls 45 % de leur capacité de calcul sont utilisés ; une utilisation à 100 % est rare, voire inexistante. D'autre part, pour les applications en temps réel, les structures informatiques conventionnelles ne sont tout simplement pas assez puissantes.

Les travaux du Dr Thomas Kämpfe se situent à l'interface entre la recherche d'une informatique économe en énergie et les composants haute performance. « Résoudre le problème énergétique de l'informatique en augmentant l'efficacité – c'est l'un des principaux axes de recherche actuels de l'industrie des semi-conducteurs, et c'est également là que réside la contribution du projet phare NeurOSmart de Fraunhofer, dont mes recherches font partie », explique Thomas Kämpfe. Avec son équipe, il développe des puces microélectroniques qui s'inspirent des réseaux neuronaux humains en termes de performances et d'efficacité. Leur consommation d'énergie est extrêmement faible.

Le problème énergétique de l'informatique

L'empreinte carbone de tous les centres de données dans le monde est d'environ 100 mégatonnes de CO2, ce qui peut être comparé à l'empreinte annuelle de l'aviation commerciale américaine avant la pandémie de coronavirus. Selon les projections, cette empreinte devrait être multipliée par 2 à 9 au cours de la prochaine décennie. En 2030, la consommation électrique des seuls centres de données pourrait atteindre 974 TWh. À titre de comparaison, l'Allemagne a consommé 565 TWh d'électricité en 2021. Cette forte consommation d'énergie est due à l'architecture de Von Neumann, le principe de construction sous-jacent des ordinateurs conventionnels.

Essentiellement, tous les processus de communication dans un tel ordinateur passent par le bus : l'entrée est transmise au bus, qui la transmet ensuite à l'unité arithmétique et à la mémoire, puis enfin aux périphériques de sortie ou à d'autres périphériques connectés. Dans cette architecture informatique divisée, il y a quatre endroits – car tout passe par le bus – où un transfert de données doit avoir lieu. Chaque transmission nécessite de l'énergie.

L'efficacité des architectures informatiques et des serveurs

Cela explique également la faible efficacité des ordinateurs conventionnels. Dans l'architecture de Von Neumann, un seul des composants peut écrire sur le bus à la fois. Les opérations d'écriture simultanées ne sont pas possibles, ce qui limite la vitesse de calcul d'un tel système. La latence ne peut être exclue. La situation est similaire pour les centres de données : les données leur sont transférées, traitées et renvoyées, avec des temps de latence. Cependant, afin d'augmenter la vitesse de calcul, les services informatiques peuvent être fournis plus près de l'endroit où ils sont utilisés, sans avoir besoin d'un serveur.

C'est le principe de l'edge computing : au lieu de transférer toutes les données vers le serveur central et de les renvoyer depuis celui-ci, ce qui consomme beaucoup d'énergie et de temps, le calcul est effectué à la périphérie du réseau. De cette façon, les temps de latence peuvent déjà être minimisés et des services en temps réel peuvent être activés. L'edge computing est également appelé « near memory computing », c'est-à-dire le traitement des données à proximité de la mémoire.

Calcul en mémoire

Notre objectif déclaré est de réduire la consommation d'énergie dans les centres de données

Thomas Kämpfe, responsable du groupe RF & AI intégré chez Fraunhofer IPMS, mène des recherches sur les composants microélectroniques à très faible consommation d'énergie. Son domaine de recherche se concentre sur le calcul en mémoire. « Avec le calcul en mémoire, le stockage s'effectue dans l'unité de calcul. Tout est traité au même endroit. Le stockage intermédiaire est évité autant que possible, ce qui permet de réduire la consommation d'énergie », explique Thomas Kämpfe.

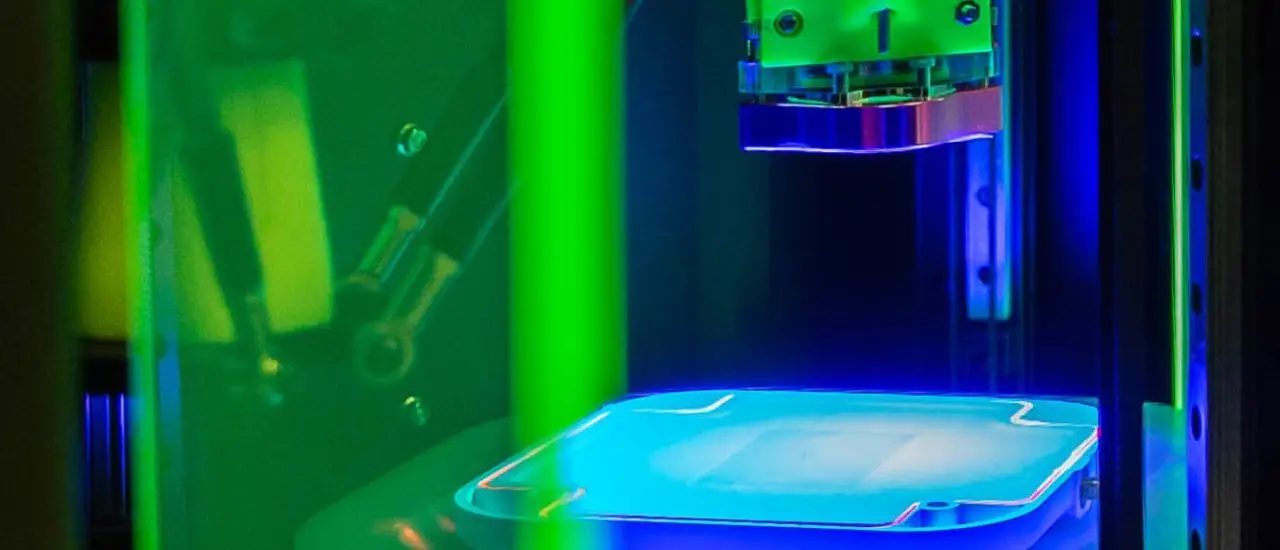

La miniaturisation des composants est au cœur des recherches industrielles menées au Fraunhofer IPMS. Des travaux sont en cours depuis longtemps pour amener ces processus à l'échelle d'une puce. Différents types de mémoire sont testés en collaboration avec différents transistors. L'objectif est de développer une mémoire à la fois petite et performante.

« Notre objectif déclaré est de réduire la consommation d'énergie dans les centres de données. Avec le calcul en mémoire, les données sont stockées dans l'unité de calcul. Tout est traité en un seul endroit. Le stockage intermédiaire est évité autant que possible, ce qui explique pourquoi moins d'énergie est nécessaire. »

Dr Thomas Kämpfe - Chefdu groupe RF & IA intégrées, Fraunhofer IPMS

Projet pilote avec des robots industriels

Dans le cadre d'un projet pilote en cours, la coopération entre les humains et les robots est enregistrée via LiDAR. L'accent est principalement mis sur la détection des humains à proximité immédiate d'un robot doté d'une IA. Le robot capture son environnement avec précision et en trois dimensions à l'aide de capteurs LiDAR.

L'objectif de ce projet est de modifier les mouvements du robot en fonction des mouvements de l'humain. L'adaptation des mouvements du robot doit s'effectuer très rapidement. Il ne doit y avoir aucun écart pertinent en matière de sécurité dû à la latence. Pour les applications de ce type, une nouvelle génération d'accélérateurs pour les algorithmes d'IA est en cours de développement au Fraunhofer IPMS afin de combler l'écart en matière de sécurité.

IA et algorithmes complexes

Le traitement de grandes quantités de données en temps (quasi) réel est souvent qualifié d'application d'IA.

« Cela est très loin de l'intelligence artificielle cognitive, qui possède une conscience, par exemple », explique Thomas Kämpfe. « L'IA, dans le langage courant, commence lorsque vous développez un algorithme capable de traiter quelque chose que vous ne pouviez pas traiter auparavant et qui peut même être prédictif. Cependant, une partie de cela peut être classée comme apprentissage automatique. Il s'agit de l'étape de développement précédant l'IA, où des analyses de régression complexes sont effectuées sur de grandes quantités de données afin de générer des résultats. Mais une IA n'analyse pas. En fin de compte, avec une IA, vous n'avez aucun moyen de savoir comment exactement l'IA évalue les données et pourquoi l'algorithme a choisi la variante de solution qu'il a choisie. »

Puce semi-conductrice neuromorphique

Informatique neuromorphique

« Le calcul en mémoire vise à accélérer ou à simplifier les opérations dont vous avez besoin à tout moment dans les algorithmes d'IA », explique Thomas Kämpfe. Le calcul neuromorphique est la prochaine étape dans cette direction. Basé sur le calcul en mémoire, il s'agit de développer des réseaux de neurones électromagnétiques qui permettent des performances de calcul en temps réel. Les neurones sont stimulés par une charge électrique transmise via un stimulus nerveux. Ils transmettent à leur tour des informations à d'autres neurones via des synapses. Il en va de même pour les neurones artificiels des puces neuromorphiques. Les neurones individuels sont reliés entre eux par des synapses.

Tous les neurones ne sont pas nécessaires pour les opérations de calcul, seuls certains le sont. Le type de connexion qui se produit dans une opération de calcul particulière a son importance. La manière dont les neurones individuels sont adressés peut être calculée à partir des poids de toutes leurs connexions sous forme de somme pondérée. Une puce neuromorphique s'organise et se régule de manière très similaire au cerveau humain. Le traitement et le stockage des données y sont fusionnés, et elle peut s'adapter de manière plastique aux performances requises en fonction de la tâche à accomplir. En d'autres termes, une puce neuromorphique peut traiter des tâches pour lesquelles elle n'a pas été programmée.

Une fois les tâches terminées, elle se reconfigure sans autre alimentation. Pour cette seule raison, les puces neuromorphiques nécessitent très peu d'énergie. De plus, il n'est pas nécessaire d'appliquer en permanence une impulsion énergétique. Un neurone artificiel commence son travail dès qu'un stimulus arrive et le termine quelques fractions de seconde plus tard.